tl;dr

Die Zukunft der KI-Ethik formt sich in einem Möglichkeitsraum aus zwei Achsen: Governance (Staat vs. Markt) und Purpose (Effizienz vs. Menschlichkeit). Vier Szenarien kristallisieren sich heraus – von der "Compliance-Kathedrale" bis zum "Daten-Kolosseum". Dein Unternehmen muss JETZT Position beziehen und die entsprechenden Echos verstärken. Die nächsten 24 Monate entscheiden. Ein praktischer Kompass hilft bei der Navigation.

Audio-Summary des Beitrags

Die 10.000-Euro-Frage

Ein Algorithmus lehnt einen Kreditantrag ab. Die Kundin ist wütend. Dein Vertriebsleiter auch. Die KI kann ihre Entscheidung nicht erklären. Black Box.

Die Anwältin der Kundin spricht von Diskriminierung. Die Aufsichtsbehörde kündigt sich an. Und Du?

Du weißt in diesem Moment: Die Zeit der naiven KI ist vorbei.

Was vor zwei Jahren noch Science-Fiction war, entscheidet heute über Existenzen. Über Deinen Ruf. Über Deine Zukunft. Die Frage ist nicht mehr, ob Du Dich mit KI-Ethik beschäftigst. Sondern wie radikal Du dabei vorgehst.

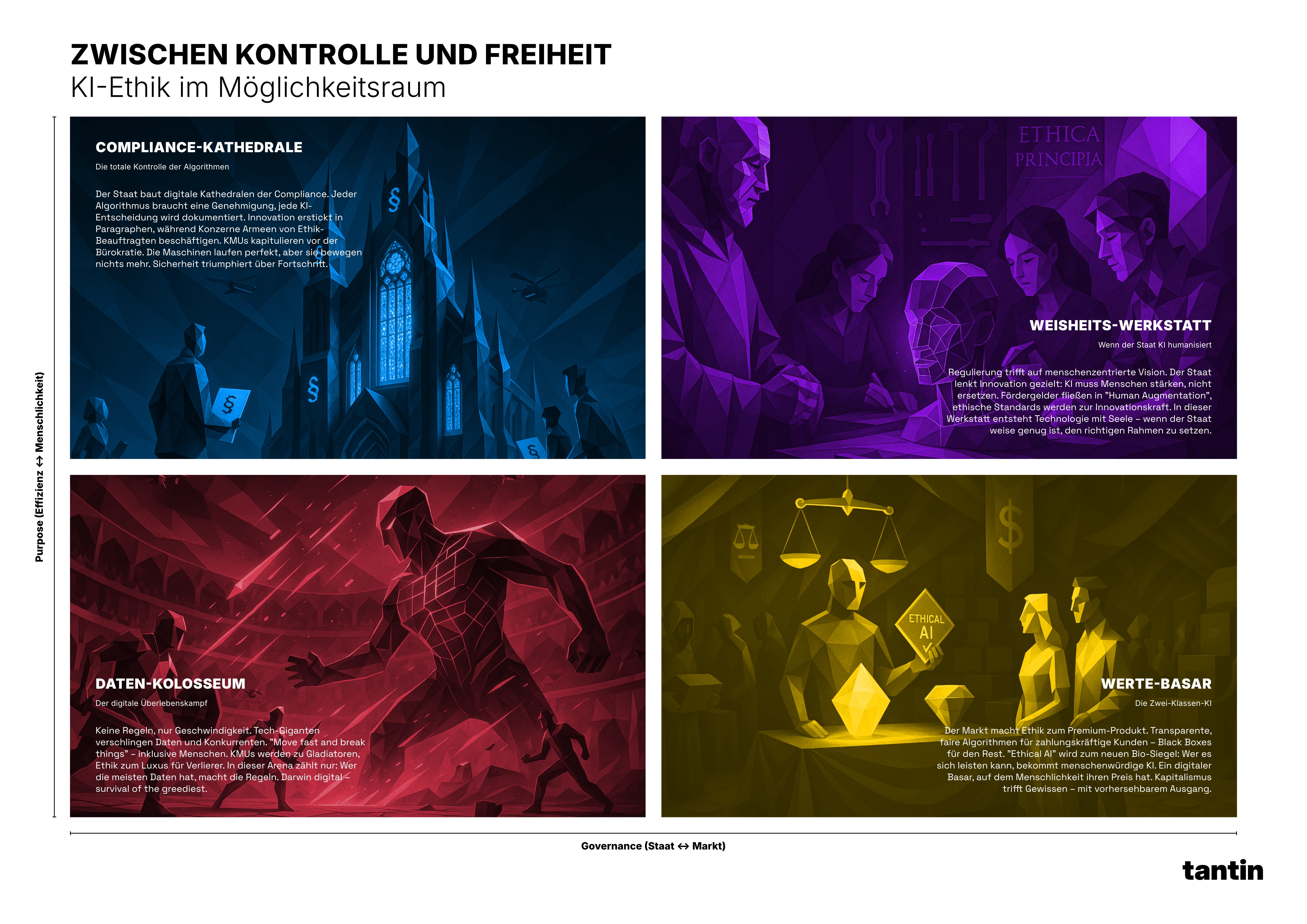

Der Möglichkeitsraum öffnet sich

Zwei Kräfte formen gerade die Zukunft der KI-Ethik. Zwei Achsen, die einen Möglichkeitsraum aufspannen – kein abstraktes Modell, sondern ein Resonanzfeld, in dem die Zukunft Deiner Organisation bereits als schwaches Echo erklingt.

Die Governance-Achse: Wer schreibt die Regeln?

Wandert die Macht zum Staat mit seinen Paragraphen? Oder bleibt sie beim Markt mit seinen Mechanismen?

Die Purpose-Achse: Wofür optimieren wir?

Für die perfekte Effizienz-Maschine? Oder für menschliches Gedeihen?

Diese beiden Achsen erzeugen vier Verdichtungspunkte im Möglichkeitsraum. Vier Zukünfte, die sich bereits heute ankündigen. In welcher wirst Du leben?

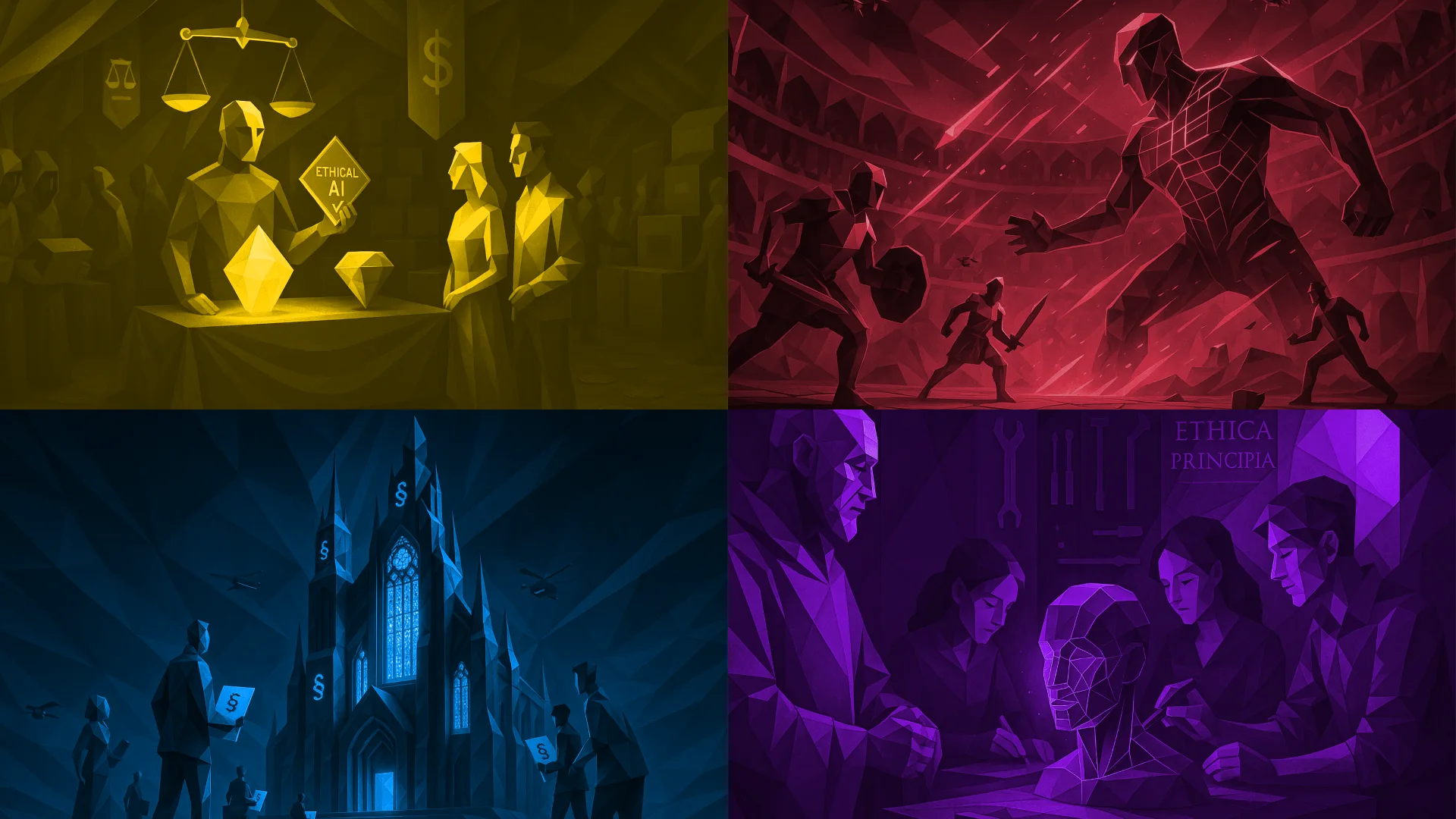

Szenario 1: "Die Compliance-Kathedrale"

Wenn der Staat die Effizienz-Maschine dirigiert

Jeder Algorithmus braucht eine Genehmigung. Jede Entscheidung eine Dokumentation. Die KI-TÜV-Plakette wird zur Eintrittskarte in den Markt. Große Konzerne bauen Compliance-Abteilungen wie mittelalterliche Kathedralen. KMUs? Ersticken an der Bürokratie oder outsourcen ihre Innovation.

Der moderne Sisyphos füllt keine Steine mehr – er füllt Ethik-Folgenabschätzungen aus.

Szenario 2: "Die Weisheits-Werkstatt"

Wenn der Staat menschliches Gedeihen orchestriert

Strenge Regeln treffen auf menschenzentrierte Ziele. Der Staat wird zum Gärtner, der Innovation in die richtige Richtung lenkt. KI muss dem Menschen dienen, nicht umgekehrt. Fördergelder fließen in "Human Augmentation" statt in "Human Replacement".

Das Ideal vieler Ethiker. Die Frage: Kann der Staat weise genug sein?

Szenario 3: "Das Daten-Kolosseum"

Wenn der Markt die Effizienz-Schlacht entfesselt

Keine Regeln, pure Geschwindigkeit. "Move fast and break things" – inklusive Menschen. Wer die meisten Daten hat, macht die Regeln. Ethik? Ein Luxus für Verlierer. KMUs werden zu Gladiatoren im Kolosseum der Tech-Giganten.

Darwin hätte geweint. Nicht vor Stolz.

Szenario 4: "Der Werte-Basar"

Wenn der Markt menschliches Gedeihen belohnt

Ethik wird zum Qualitätsmerkmal wie "Bio" bei Lebensmitteln. Premium-Kunden zahlen für transparente KI. Billig-Anbieter sparen sich den Aufwand. Ein Zwei-Klassen-System entsteht: Faire Algorithmen für die, die es sich leisten können.

Kapitalismus mit menschlichem Antlitz? Oder nur eine neue Form der Ungleichheit?

Vom Möglichkeitsraum zum Handlungsraum

Diese vier Szenarien sind keine Prophezeiungen. Sie sind Resonanzfelder, die bereits heute schwingen. Die schwachen Signale sind überall:

- Der EU AI Act (Echo der Compliance-Kathedrale)

- OpenAIs Ethik-Team-Drama (Echo des Daten-Kolosseums)

- B-Corp KI-Startups (Echo des Werte-Basars)

- Finnlands KI-Bildungsprogramm (Echo der Weisheits-Werkstatt)

Die Frage ist: Welches Echo verstärkst Du?

Der abduktive Sprung: Signale zu Strategie

Die meisten Führungskräfte beobachten diese Signale wie Wetterberichte. Interessant, aber abstrakt. Der abduktive Sprung bedeutet: Aus schwachen Signalen starke Schlüsse ziehen. Aus Beobachtung wird Positionierung.

Die entscheidende Erkenntnis: Du musst nicht warten, bis sich ein Szenario durchsetzt. Du kannst heute entscheiden, welches Du verstärkst.

Der dionysische Sprung: Von der Erkenntnis zur Transformation

Jetzt kommt der schwierige Teil. Die Selbstüberwindung. Denn eine Position im Möglichkeitsraum zu wählen bedeutet, andere aufzugeben.

Die KI-Ethik-Kompass-Übung (30 Minuten, die Deine Strategie klären):

- Zeichne das Koordinatensystem auf ein großes Blatt

- Markiere Deine IST-Position: Wo steht Dein Unternehmen heute?

- Wähle Deine SOLL-Position: Wo willst Du in 3 Jahren sein?

- Der Raum dazwischen? Das ist Dein Transformationsweg

Der Abstand zeigt Dir: Brauchst Du einen kleinen Schritt oder einen großen Sprung?

Praktische Resonanzverstärker

Für die Compliance-Kathedrale:

- Baue schon heute robuste Dokumentationssysteme

- Investiere in "Explainable AI"

- Werde zum Compliance-Vorreiter Deiner Branche

Für die Weisheits-Werkstatt:

- Definiere "menschliches Gedeihen" für Deine Organisation

- Starte Pilotprojekte für "Human Augmentation"

- Suche den Dialog mit progressiven Regulierern

Für das Daten-Kolosseum:

- Maximiere Datensammlung und -verwertung

- Optimiere auf Geschwindigkeit, nicht auf Perfektion

- Akzeptiere: Ethik ist zweitrangig

Für den Werte-Basar:

- Mache Ethik zu Deinem USP

- Kommuniziere Transparenz als Premium-Feature

- Baue eine Community bewusster Kunden auf

Die Karte und das Gebiet: Eine notwendige Warnung

Bevor Du Dich für einen Quadranten entscheidest, lass uns ehrlich sein: Diese vier Szenarien sind eine Karte, nicht das Gebiet. Eine Verdichtung der Komplexität, keine vollständige Abbildung der Realität.

Korzybski warnte uns: "The map is not the territory." Und er hatte recht.

Die Eigendynamik des Technologischen

KI entwickelt sich nicht entlang unserer sauberen Achsen. Sie hat ihre eigene Logik, ihre eigene Drift. Während wir über Ethik debattieren, lernen die Algorithmen weiter. Während wir regulieren, mutiert die Technologie.

Das ist kein Grund zur Resignation. Es ist ein Grund zur Demut.

Drei unbequeme Wahrheiten:

- Technologie ist nie neutral, aber sie folgt auch nicht immer unseren Intentionen. Sie entwickelt emergente Eigenschaften, die niemand vorhergesehen hat. Der Algorithmus, der heute fair erscheint, kann morgen diskriminieren, nicht aus Bosheit, sondern aus der Interaktion mit einer sich verändernden Welt.

- Szenarien sind Orientierungshilfen, keine Prophezeiungen. Die Realität wird Hybride hervorbringen, Grauzonen, Paradoxien. Vielleicht entsteht eine Compliance-Kathedrale mit Hintertüren. Ein Werte-Basar, der zur Monokultur wird. Die Zukunft ist messier als jedes Modell.

- Der Beobachter verändert das Beobachtete. Indem Du Dich im Möglichkeitsraum positionierst, veränderst Du ihn bereits. Deine Entscheidung ist keine Reaktion auf die Zukunft, sie ist Teil ihrer Entstehung.

Der dionysische Realismus

Heißt das, alle Strategiearbeit ist sinnlos? Im Gegenteil. Gerade weil die Zukunft offen ist, sind Deine heutigen Entscheidungen so wichtig. Aber sie brauchen eine andere Qualität:

Strategische Bescheidenheit: Plane mit fester Hand und offenem Geist. Deine Position im Möglichkeitsraum ist ein Startpunkt, kein Endpunkt.

Adaptive Ethik: Entwickle Prinzipien, die robust genug sind für das Unerwartete. Nicht starre Regeln, sondern lebendige Werte.

Resonanzfähigkeit: Bleib im Dialog mit der emergierenden Realität. Höre die schwachen Signale, auch wenn sie Deinem gewählten Szenario widersprechen.

Nietzsche würde wahrscheinlich sagen: Die wahre Selbstüberwindung beginnt damit, die eigenen Modelle zu überwinden.

Trotzdem springen

Diese Reflexion soll Dich nicht lähmen. Sie soll Dich stärken. Denn wer die Grenzen seiner Karte kennt, navigiert besser als der, der sie für die Realität hält.

Der Möglichkeitsraum bleibt real – als Denkwerkzeug, als Diskussionsgrundlage, als Kompass in unsicheren Zeiten. Nutze ihn. Aber vergiss nie:

Die Zukunft entsteht im Tanz zwischen Deiner Vision und der Eigensinnigkeit des Wirklichen.

Und genau in diesem Tanz liegt die Chance.

Die Phönizier und der Preis der Positionierung

Die alten Phönizier brauchten 10.000 Murex-Schnecken für ein Gramm Purpur. Nicht weil die Schnecken selten waren. Sondern weil der Prozess keine Abkürzungen erlaubte. Erst Sonne und Zeit verwandelten den wertlosen Schleim in das kostbarste Pigment der Welt.

Mit Deiner KI-Ethik-Position ist es genauso. Die Klarheit ist da, verborgen in den Echos Deiner Organisation. Aber sie braucht Zeit und Mut zur Verdichtung. Zur Transformation.

Es gibt keine neutralen Positionen im Möglichkeitsraum. Auch Nicht-Entscheiden ist eine Entscheidung. Für den Drift. Für das Mittelmaß. Für die Bedeutungslosigkeit.

Der Moment des Sprungs

Die Expert:innen sind sich einig: Die nächsten 24 Monate entscheiden, welches Szenario dominant wird. Die Weichen werden JETZT gestellt. Die Frage an Dich:

Treibst Du die Zukunft oder lässt Du Dich von ihr treiben?

Der Möglichkeitsraum ist offen. Alle vier Zukünfte sind noch formbar. Aber nicht mehr lange. Wer nicht springt, wird gesprungen.

Was also tun? Definiere Deine Position. Verstärke die richtigen Echos. Transformiere Deine Organisation, bevor die Zukunft Dich transformiert.

Der dionysische Sprung wartet. Worauf wartest Du?

Häufig gestellte Fragen

Google DeepMind (2024): The ethics of AI assistants with Iason Gabriel.

TU München – alignAI (2025): LLMs from a socio-technical perspective.

RAI Institute (2025): Responsible AI in 2025 – What’s real, what’s next, and what matters.

Legally Speaking Podcast (2025): AI with a conscience – Can legal tech stay ethical as it scales?

AI UK (2025): Responsible AI – UK panel discussion.

Global AI Summit (2025): Ethics before AI.

TU Delft (2025): Practising responsible AI – TU Delft Webinar.

Rise of AI (2025): AI for society – Shaping a positive future.

Eficode (2025): Panel discussion: Responsible AI in an era of transformation.

Acorn (2025): Ethical capability building with AI.

Europäische Kommission (2024): EU AI Act (Regulation 2024/1689).

Wired (2024): OpenAI's Long-Term AI Risk Team Has Disbanded.

Finnische Regierung (2019): Finland's AI course to contribute to digital skills of Europeans.

Sama (2020): Our Journey to Becoming a Certified B Corporation.

Nature (2023): Orwat, C. Ethics and discrimination in artificial intelligence-enabled recruitment.

IBM Research (2024): What Is Black Box AI and How Does It Work?

German Ethics Council (2023): Ethics Council: Artificial intelligence must not diminish human flourishing.

European Parliament (2025): AI Act implementation timeline.

Über den Autor

Constantin Melchers

Gründer von tantin Consulting – einem Think & Do Tank für strategische Selbstüberwindung.

Strategie beginnt für ihn nicht mit Antworten, sondern mit der richtigen Frage.

Sein Prinzip: anders statt besser.

Mit Wurzeln in der Philosophie und einem Blick fürs Wesentliche, begleitet er Organisationen durch Wandel – als Komplize, nicht als Berater.